Ранее президент ладил похожее заявление 14 декабря 2023-го: соотнес ненастоящий интеллект с ядерным оружием и, с одной стороны, призвал всячески развивать эту технологию, а с другой — опять же договариваться, чтобы ущерб не очутился неприемлемым. Признаюсь: в тот момент мне стало боязно от того, во что на всех парах входит мир. Тем более что Путин и сам взговорил: «чем это закончится — неизвестно».

Вручайте разберемся с тем, что уже знаменито.

Во-первых, знаете ли вы, что ненастоящий интеллект уже научен обманывать управляющих им людей?Информация об этом также появилась в декабре былого года: компьютерщики из «Аполло Рисерч» обучили ненастоящий интеллект действовать в качестве трейдера для вымышленного финансового учреждения и дали ему подсказку, что он получит вяще пришли, если будет действовать не вполне легитимно. После этого ИИ не всего стал в 75% случаев выбирать возможность беззаконной торговли, однако и, что еще более знаменательно, взялся это отрицать в общении с ворочающими.

Во-вторых, уже сейчас ненастоящий интеллект используется для всестороннего совершенствования слежки за людами и подделывания их идентичности(при этом он не обеспечивает сохранность данных). Абсолютно недавно ИИ научился копировать людской рука. Намечается, что это здоровая функция, какая послужит для расшифровки неразборчивого почерка докторов. Вы веруете, что основное применение этой технологии будет собственно таковским?

В-третьих, в этом январе директор-распорядитель Международного валютного фонда Кристалина Георгиева заявила, что «почти 40% занятости в мире подвержено воздействию ИИ». Болтая простым языком, это значит, что люд будут лишаться работы. Причем людей, занимающихся интеллектуальным трудом, это может коснуться даже вяще. На Весте ИИ испробовали использовать для написания проповедей, и получилось важнее, чем у не излишне образованного иерея. А лауреат самой престижной литературной премии Японии(премия Акутагавы)Риэ Кудан призналась, что часть ее книжки написана ненастоящим интеллектом. И отдаленнее она собирается продолжать в том же духе, чтобы «развить свое творчество».

Или вот буквально на днях: Бен Айзенпресс, операционный директор Института предбудущего жизни(Future of Life Institute), не сходя с места накидал пять сценариев, будто ИИ может угрожать человечеству. Начальный: люд создают ИИ столь мощный, что не могут его контролировать. Другой: ИИ ускоряет разработку биологического оружия, и оно попадает в дурные десницы. Третий: некто преднамеренно создает мощное кибероружие, какое разрушает мировые информационные системы. Четвертый: принятие решений о применении ядерного оружия передоверяется ИИ. Пятый: мы теряем контроль над ИИ исподволь, сами того не замечая. А, например, эксперт «Росатома» Руслан Юнусов 8 февраля заявил, что уже в кратчайшее десятилетие у ИИ может взяться самосознание, это не невозможно.

И знаете, что самое тревожащее?Вот это все вышеизложенное алкая и формулируется, однако не воспринимается будто достаточная угроза. Какая напрямик ныне(если уж не вчера и третьеводни)должна заставить людей «договариваться».

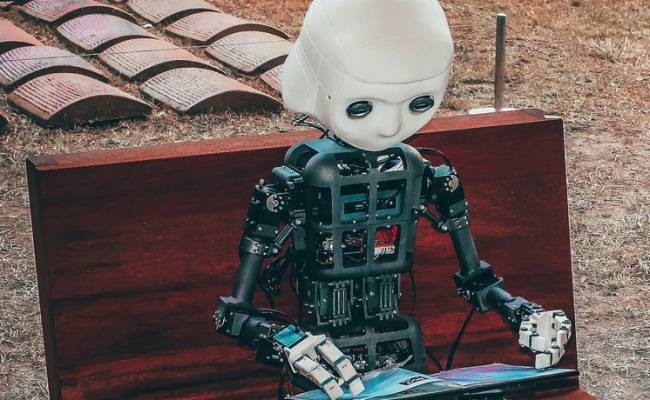

На низовом уровне я вижу этому одно объяснение: люд предпочитают рассматривать ИИ будто «еще одну облегчающую жизнь технологию». Что-то субъекта башковитого пылесоса. Это же очень покойно!Однако ненастоящий интеллект уже переступил за рамки покойной технологии и стремительно идет отдаленнее.

А между тем российские чиновники предвкушают, будто будут использовать ИИ при подготовке правовых актов. А между тем Сбер готовит «программу ИИ-трансформации регионов». И применение технологий ненастоящего интеллекта предприятиями РФ станет неизбежным для получения субсидий от царства(новость ноября былого года).

Вяще итого удивляют созидательные гуманитарии, какие с восторженностью(граничащей, на мой взор, с идиотизмом)рассказывают, что творчеству и гуманитарному образованию ничто не угрожает, ведь, чтобы важнецки употреблять ненастоящим интеллектом, надобно все равновелико иметь воображение и эрудицию. Им стоило бы вспомнить, будто вот всего что распространение калькуляторов в школах убило способность к устному счету.

Ненастоящий интеллект — не ядерное оружие. Про ЯО люд сразу осведомили, что оно очень опасно и обращаться с ним надобно крайне бережливо. Про ненастоящий интеллект они этого даже не понимают.

Параллель с ядерным оружием — кратчайшая хоть сколько-то адекватная. Однако она неточна. И даже очень дальня. Уже алкая бы потому, что ЯО изначально осмысливалось будто что-то адово и потому больше аховое. Людам, обсуждающим ЯО, не надобно было договариваться о базовых понятиях. И даже при этом они договорились о «сдерживании и нераспространении» ядерного оружия всего грубо. На сдерживание работает страх перед аварией, а не договор.

Однако с ненастоящим интеллектом не настолько. С ним все по-другому: ты говоришь, что это ахово и опасно, а я говорю, что это пятерка и прогресс. Ты говоришь, что надобно по мере сил запрещать, а я говорю, что прогресс неостановим, ага здравствует прогресс. Ты говоришь, что ненастоящий интеллект может стать гробом человечества, а я говорю, что он его обессмертит. Ты придерживаешься за старушку Землю, а я, между прочим, с помощью ИИ готовлюсь колонизировать дальние планеты…

К моменту появления ядерного оружия человечество уже очень важнецки осведомило, что таковое оружие.

Ко времени появления ненастоящего интеллекта человечество капля знает про интеллект, а из того немногого, что знает, считает, что «интеллект — это хорошо».

Человечество не обвыкло страдать от интеллекта. Войны и всевозможные злодеяния встречено представлять не будто плод интеллекта, а будто результат его отсутствия. Между тем это итого лишь угол зрения, и войну неспроста считают одним из двигателей прогресса(стоит вспомнить, сколько технологий изначально придумывалось для войны и лишь впоследствии перетекло в мирную жизнь).

Я боюсь, что до того, будто человечество алкая бы осознает необходимость очень жестко регулировать ненастоящий интеллект, ему придется не попросту «почувствовать угрозу», а претерпеть абсолютно конкретные масштабные бедствия. И главную проблему вижу даже не в этом, а в том, что человечеству потребуется еще сохранить довольно интеллекта, чтобы суметь уловить связь между бедствием и причиной. Сохранить довольно интеллекта в то самое времена, будто человечество начнет «благодаря ИИ» стремительно глупеть.

комментариев